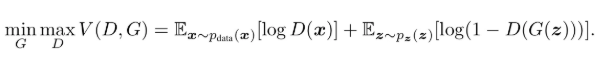

이번 포스팅에서는 WGAN 및 WGAN의 개선판(WGAN-gp)에 대해서 설명한다. 1. GAN의 문제점 - 학습이 어렵다. ▶ 기울기 손실 문제가 발생한다. - 생성 결과의 퀄리티를 손실함수로부터 판단하기 힘들다. - 모드 붕괴가 일어난다. 2. 개선 방법 - Wasserstein GAN의 도입 ▶ Wasserstein거리에 의한 손실함수의 설계 ▷ 요소를 만족하기 위해 가중치를 클리핑 (WGAN) ▷ 학습이 불안정한 문제 ▶ 다른 방법으로는 Grgdient penality를 도입 (WGAN-gp) 3. 기본 구조와 비교하여 변경된 점 - 손실함수 (binary cross entropy에서 Wasserstein loss로) - discriminator의 구조 (1) 손실함수 먼저 손실함수에 대해 설명한..